2024-02-13 擴充產品

大模型的出现一下子让机器人变聪明了,使它们不仅能更好地和人类对话,而且好像还有了常识,甚至也会推理了。这让我们对机器人的印象大为改观。

最近,来自新加坡国立大学、日本名古屋大学、北京交通大学和东京工业大学的多位学者在卓越计划高起点新刊Biomimetic Intelligence and Robotics(《仿生智能与机器人(英文)》上发表了题为“Large language models for human–robot interaction: A review”的综述文章,重点介绍了大型语言模型在增强其结构和性能方面的最新进展,综合分析了大语言模型在人机交互中的应用与挑战。尤其是在多模态输入处理、高层推理和计划生成方面,大模型展现出了强大的能力。此外,他们还探讨了将大语言模型整合到机器人系统中,以完成复杂任务的方法。其中,从传统的概率模型到使用价值函数和度量进行最优决策,都是当前研究的热点。

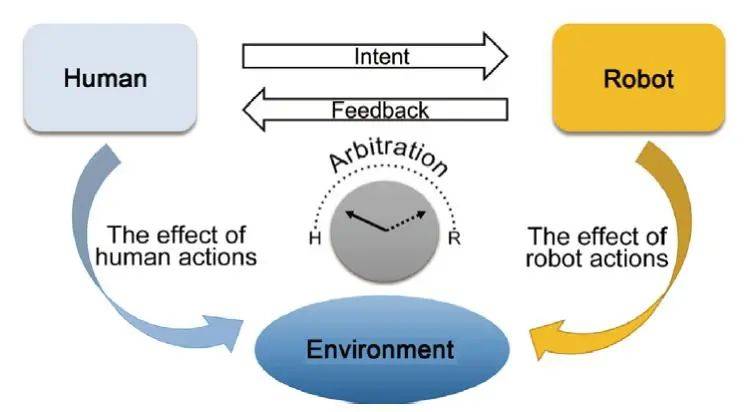

在早期的机器人时代,机器人没有触觉,所以我们应该一些特殊的设备来帮助人与机器人交流。这些设备就像“触觉增强器”,让机器人能感受到人类的存在和反应。

想象一下,你穿上了一件外骨骼,然后与机器人进行了一次亲密的“握手”。这不仅仅是握手,你的外骨骼还能检测你施加的扭矩和运动方向,它知道你的每一个动作。这样,机器人就能依据这一些信息做出反应,为你提供最合适的反馈。

另外,你还能够正常的使用“振动手镯”来指导机器人执行任务。这个手镯可以跟踪你的运动轨迹,然后告诉机器人该如何走。这样,你和机器人就可以像真正的伙伴一样,默契地完成各种任务。

当然还可以用虚拟现实。VR让触觉进入虚拟世界,让我们的视觉进入了一个全新的世界。以前,我们只可以通过可穿戴设备与机器人进行触觉交流,现在,VR技术让这一切变得更有趣和直观。

现在还有一些运动生成算法,它们让机器人能够在虚拟环境中找到最佳路径,就像在真实世界中一样。而且机器人还会为咱们提供触觉反馈,让我们感受到虚拟世界的物体。

另一种是通过远程操作与机器人进行互动。实际上,这样的形式已经在很多危险或狭小的环境中派上了用场。不过这种操作需要一定的技巧和经验,而且虽然机器人能代替我们进入危险区域,但它们毕竟不是真人,缺少了我们的自然肢体语言。

为了解决这一个问题,科学家们设计了一些有趣的界面,让我们的肢体动作或眼神成为控制机器人的“遥控器”。这样,即使你的手不方便移动,也可以轻松地操作无人机或机械臂。

远程操作让我们能够轻松地控制机器人,并在各种应用中发挥潜力。这就需要更强的态势感知能力,也就是快速感知、理解和应对周围环境的能力。它直接关系到我们远程操控机器人的水平。这里可以采用增强现实界面,能更精确、更可靠地反映机器人看到的情况。

对话就是我们平时说话交流的方式,这是最自然的方式。如果我们能让机器人也理解并参与到我们的对话中来,那它们就能更容易地融入我们的生活,但这并不是一件简单的事。

机器人不仅要听懂我们的话,还得知道什么时候该说话,什么时候不该说话。有时候,它们还得告诉我们,它们想要开始、继续或者结束对话。为了解决这些问题,科学家们想了很多办法。他们创建了一个可以衡量机器人参与对话程度的模型,并且教机器人如何在对话中表现得更好。

在实际应用中使用语言能力也很重要。比如机器人要通过拥挤的地方,如果前面有人挡住了去路,它们需要请求人们让它们过去。

而有时候,人们说的话可能会有点含糊、指代不清,这会让机器人感到困惑。不过,科学家们已经开发出了一些系统,用于处理在执行任务时可能发生的对话行为,并且能够灵活地应对各种变化。

另一种方法是,系统涉及交互式过程。通过利用机器人的请求理解和对周围物体的认识,寻求额外的信息来区分所描述的对象。这就像是在玩一个解谜游戏,机器人需要用它的“大脑”来理解我们的语言,并找出正确的答案。

除了语言之外,人类在交流时也会使用重要的非语言线索,比如眼神、肢体语言等。科学家们正在探索如何让机器人理解这些线索,以便更好地与人类互动。

随着大型语言模型的出现,我们有了更多的可能性来解决这些问题,并帮助机器人更好地融入我们的生活。

过去十年里,大型语言模型确实让自然语言处理焕然一新。它们用大量的数据和其他建模领域的复杂神经网络架构,展现了理解、生成和操控人类语言的新能力。像GPT这样的模型,在文本生产、翻译、情感分析和问答等任务中都表现得非常出色。随着它们在各个领域和日常生活中的广泛应用,研究人员还在努力探索大模型的极限。

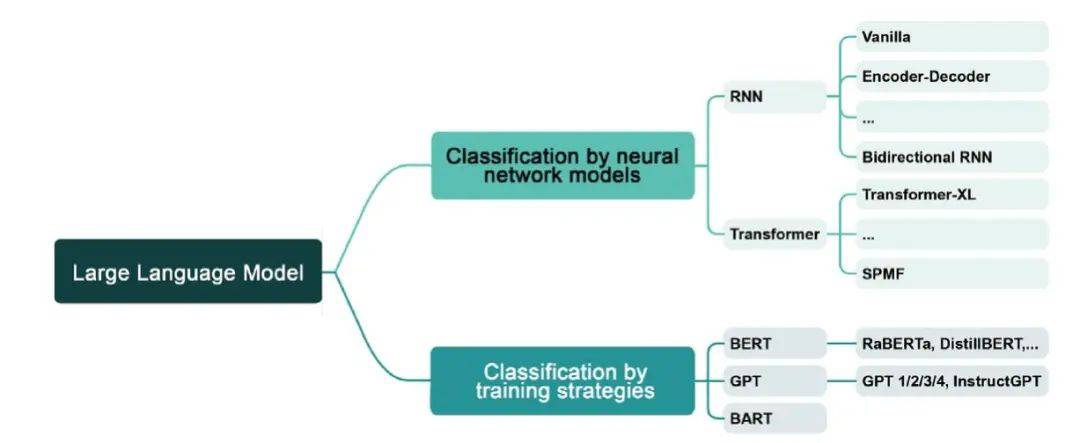

早期的循环神经网络(RNN)语言模型通过短期记忆解决了前馈网络在语言建模方面的局限性。通过反向传播、因子分解和编码器-解码器框架的增强,RNN语言模型得到了改进。双向RNN可以让我们考虑单词前后的上下文。但随着自注意力和多头注意力机制的引入,Transformer架构彻底改变了自然语言处理任务。像Transformer-XL这样的进步,通过在段落间循环缓存来扩展上下文长度。自适应注意力跨度能自动学习最佳注意力跨度。还有一些变体通过使用辅助损失、稀疏注意力矩阵分解和结合Transformer和RNN的属性等技巧来提高效率。大型语言模型在很多领域都能派上用场,比如通过像素关联和强化学习来生成图片。Transformer也很有用,在人机交互等领域,也能看到Transformer的身影。

除了按照网络结构来分类语言模型,还有一个方法是按照它们的训练策略来分类。基于Transformer的版本被广泛用于满足各种用户需求。现在流行的模型可以追溯到两个基本方法——GPT和BERT。GPT使用自注意力机制,并在未标记的文本上进行预训练,展示出通过任务如文本生成和创意写作进行迁移学习的潜力。GPT-2通过更大规模的非监督学习改进了少量和零样本的迁移。GPT-3进一步将规模扩大了100倍,证明更大的模型表现更好,验证了扩展定律。

BERT也展示了使用双向编码和预训练任务(如掩码语言建模和下一句预测)的成果。它的变体旨在提高效率,通过减少参数和训练时间,同时不损失性能。ALBERT对嵌入和共享层进行分解,而RoBERTa优化了预训练决策。DistilBERT和TinyBERT将大小最小化,而SpanBERT掩码了跨度而不是令牌。其他模型也不断进步,比如GPT-4具有前所未有的解释能力,InstructGPT通过反馈引入强化学习,BART结合了GPT和BERT的优点。

除了这些著名的模型外,大型语言模型还有潜力通过将模糊的人类指令翻译成控制信号来让机器人变得更智能,以满足不同应用场景中的用户需求。

大型语言模型现在能通过搜索引擎和问答系统,很快地把我们的问题和答案对上号,让我们能方便地查找各种知识。比如说,机器翻译就是用了问答系统,才能快速地在不同语言之间做翻译。研究也发现,只要模型够大,用大量的文字资料训练出来的语言模型,效果可以赶上其他更复杂的方法。而且,加上注意力机制之后的深度神经网络,能让模型读懂文件,回答复杂问题,哪怕之前对相关领域完全不了解也没关系。

虽然模型能根据文字提示编出很长的故事,但如果提示太模糊或者没有提示,模型可能就会产生偏差或者加入一些不需要的内容。为了解决这样的一个问题,专家们想出了控制代码、属性分类器和交互式查询重写等方法。控制代码能控制生成的内容,属性分类器和查询重写则能让内容更加明确。优化查询的数据结构之后,还能节省时间和内存。

最新的研究已经不再局限于文字了,开始探索图像、视频和音频等多模态的生成。模型可以在带有标签的图片数据集上进行预训练,不再需要手动标记。通过扩展功能,模型还能把视频和文本联系起来,或者用CLIP等框架加入音频,强化不同模态之间的联系。这样一来,人机交互就能更加顺畅了。现在的研究甚至能让模型根据语音生成代码、做出动作,或者从语音中生成完整的人类动作。随着模态和结构的不断改进,语言模型现在已经能根据具体情况,对医学教育等领域中的问题给出不同的答案。但是,我们也得小心,因为有些看起来很真实的文本,其实可能是模型编造出来的。所以,我们在使用模型生成的结果时,一定要保持理性,毕竟人类才是主导者。

将社交机器人融入人类社会一直是研究的热门话题。社交机器人可以通过自然的对话来帮助人们,而不会让人感到不舒服。但是,它们缺乏推理能力,这使它们很难获得常识,并可能导致危险。大型语言模型的引入极大地改变了这一局面,它们提供了经过预训练的模型,这些模型可以作为广泛的知识库进行泛化。

社交机器人的一个重要应用领域是教育。教室里的机器人可以因材施教,提供更个性化的课程。使用增强现实、语音机器人和ChatGPT的框架进一步促进了外语学习。聊天机器人凭借其出色的推理能力,还可以为孩子们生成连贯的故事。在更深层次上,语言模型可以理解模糊的内容,比如哲学。

而在医疗保健领域,有了大模型加持的机器人可以和自闭症患者聊天,还可以提供其它新颖的人机交互方法。研究表明,ChatGPT对医学诊断的理解是足够深入的。

语言模型让虚拟智能体能够执行多模态的指令和生成任务,这使得它们在实体机器人应用中具有巨大的潜力。这种技术可以助力日常任务或自动化生产线的实现,让机器人更便捷地根据指令生成高层任务和运动计划,而不需要大量的编程工作。

这里的一个问题是,人类的指令经常很笼统而且不明确。为了完成像准备早餐这样的任务,机器人需要运用常识推理将语言指令转化为动作计划。早期技术使用先验知识概率模型来推断缺失的元素,但这种方法依赖于预定义的链接数据。为了更灵活地执行各种任务,需要更低成本的数据抽取。因此,许多研究采用语言模型作为机器人的大脑,利用常识知识进行决策,并执行生成的计划。

最新研究进展表明,文字和视觉等多模态输入可以用来理解环境和生成任务计划,然后通过价值函数或测量标准选择最佳方案。虽然初步的计划可能看起来是最好的,但未预见的变化需要在线优化。状态反馈可以根据当前情况评估计划的有效性。成功检测和场景描述通过内部对话逐步优化跨领域的指令执行。当存在不确定性时,可以通过物体配重或询问人类来缓解不确定性。

语言模型技术还可以支持特定领域的任务模型。预训练模型甚至可以直接从指令中生成控制策略,无需进行微调。多个智能体之间的角色扮演可以协作完成非同寻常的多机器人任务,推动智能控制的发展,使其能够无缝地融入人机交互。

虽然大型语言模型在人机交互方面很强大,但要安全、有效地使用它们,还有一些挑战需要解决。首先,要确保它们不会因为不恰当、有偏见或私密的内容而造成危害。其次,与用户互动时,要保护用户的隐私,并遵守公平等道德原则。

而且大模型有时候不太理解对话的细微差别,这可能会让用户感到沮丧。比如,如果它误解了用户的查询或回答,用户可能会感到困惑。这对于需要正确理解用户意图的交互来说非常重要,比如在指导机器人完成任务时。

此外,大模型在不同的背景、语言和用户之间也有应用挑战。比如,如何让它在各种情况下都能理解和回应用户的指令。如果它不能很好地适应不同的环境和用户,那么它可能无法发挥出它的全部潜力。

还有一些其它问题需要解决。比如,如何训练大模型、如何设计和微调它以改善性能。这样一些问题的解决对于将机器人成功融入人类社会至关重要。

毛泽兵,博士,东京工业大学机械工程系长聘研究员。2012年和2015年分别获得山东大学和浙江大学学士和硕士学位,2017年和2019年获得日本东京工业大学硕士和博士学位。曾在东京工业大学创新研究所和芝浦工业大学智能材料研究所担任博士后研究员、助理教授和讲师等职务。主要研究方向涵盖流体式柔性执行器和机器人、张拉整体机器人的先进传感技术,以及人机互动领域中大语言模型的开发等方面。

彭彦鸿,名古屋大学信息与通信工程专业博士在读。2019年获得北京交通大学和澳大利亚伍伦贡大学机械电子工程学士学位,2021年获得日本名古屋大学机械系统工程系汽车工程硕士学位。研究兴趣包括软体机器人、仿生机器人、可穿戴机器人和机器学习。

Biomimetic Intelligence and Robotics(《仿生智能与机器人(英文)》,CN 37-1527/TP,ISSN 2667-3797)是由教育部主管,山东大学主办,山东大学科技期刊社与爱思唯尔(Elsevier)联合出版的国际学术期刊,2019年入选中国科技期刊卓越行动计划。期刊聚焦仿生学、机器人和AI相关领域,接收包括原创研究论文、综述、短通讯等多种类型的文章,对作者和读者均免费,平均审稿周期30天。目前已被Ei Compendex、Scopus、INSPEC和DOAJ等国际数据库收录。